Week 1 · Day 1/30

LLM Fundamentals

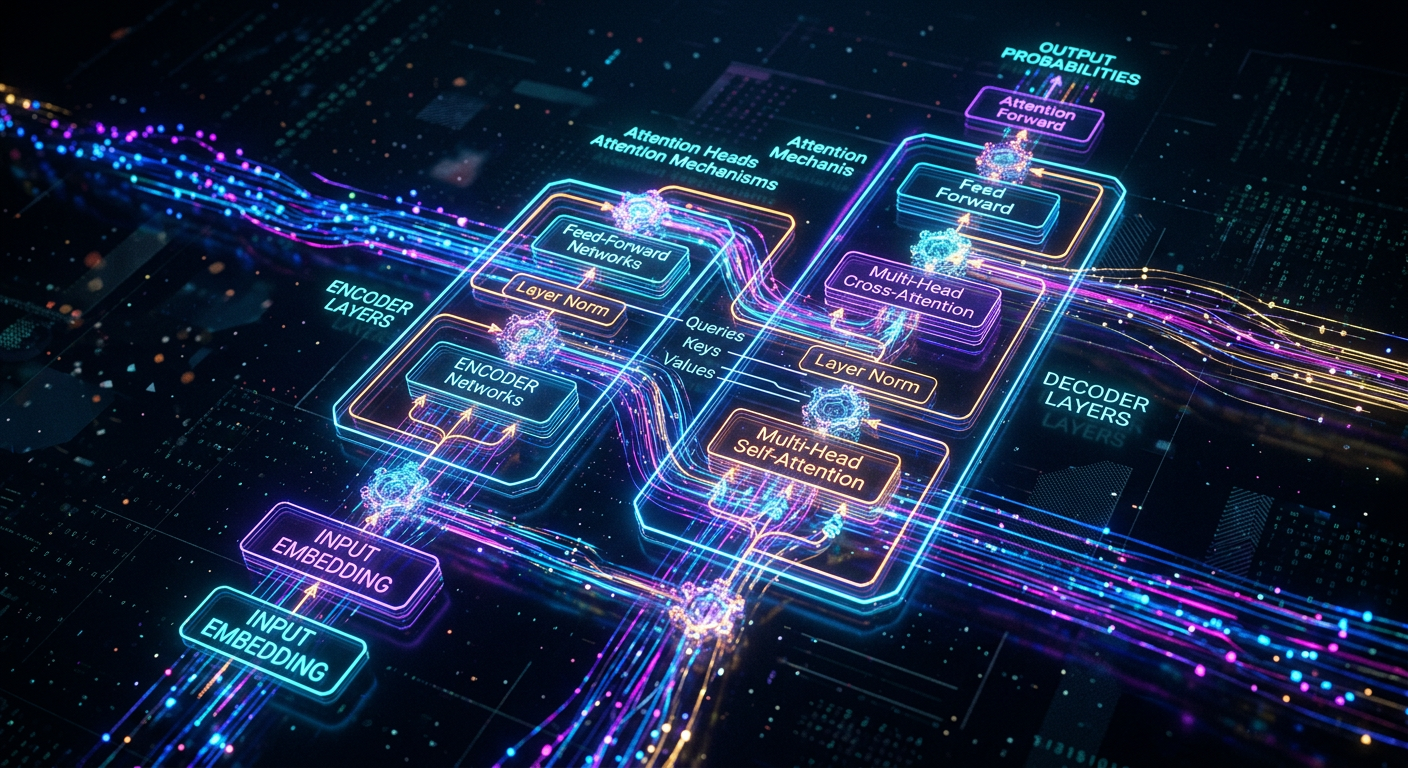

Ako fungujú transformery, attention mechanizmus a tokenizácia

Celkový progres

3%

🎯 Cieľ dňa

Pochopiť architektúru transformerov, self-attention mechanizmus (Q/K/V matice), multi-head attention, positional encoding a tokenizáciu (BPE). Toto je základ všetkého čo príde.

📚 Study Resources

3Blue1Brown — Attention in Transformers, Visually Explained

Najlepšia vizuálna explainécia attention mechanizmu. Začni tu.

videoThe Illustrated Transformer — Jay Alammar

Klasická referencia. Vizuálny walkthrough celej transformer architektúry.

articleHugging Face LLM Course — How Do Transformers Work?

Free hands-on kurz s kódom. Transformers internals od Hugging Face.

courseDeepLearning.AI — How Transformer LLMs Work

Free short course od Andrew Ng's tímu. Buduje intuíciu s code examples.

courseAndrej Karpathy — minBPE Tokenizer from Scratch

Buildni BPE tokenizer from scratch. Lecture notes sú zlato.

hands-on💡 Key Concepts

Transformer Architecture — Encoder-decoder štruktúra, prečo nahradila RNNs/LSTMs (paralelizácia, long-range dependencies)

Self-Attention — Query, Key, Value matice; scaled dot-product attention; ktoré tokeny sa 'pozerajú' na ktoré

Multi-Head Attention — Viacero attention operácií paralelne (GPT-3 má 96 hláv na blok) — zachytávajú rôzne typy vzťahov

Positional Encoding — Ako transformery vedia poradie slov, keď spracúvajú všetky tokeny súčasne

Tokenizácia (BPE) — Subword tokenizácia, Byte Pair Encoding, prečo bugy v tokenizéri spôsobujú problémy v LLM

Embeddings — Ako sa slová stávajú vysoko-dimenzionálnymi vektormi nesúcimi sémantický význam

🔧 Praktické cvičenie

Buildni BPE tokenizer from scratch.

- Klonuj karpathy/minbpe, prečítaj lecture.md

- Implementuj basic BPE algoritmus v Pythone

- Natrénuj ho na malom textovom korpuse

- Porovnaj output s OpenAI tiktoken na rovnakom texte

- Pozoruj ako sa rôzne texty splitujú rôzne